Даниил Берштейн: Подделать Путина – легко

Как организовать дипфейк, даже с участием президента «Собеседник» выяснял у IT-специалиста «Яндекса»

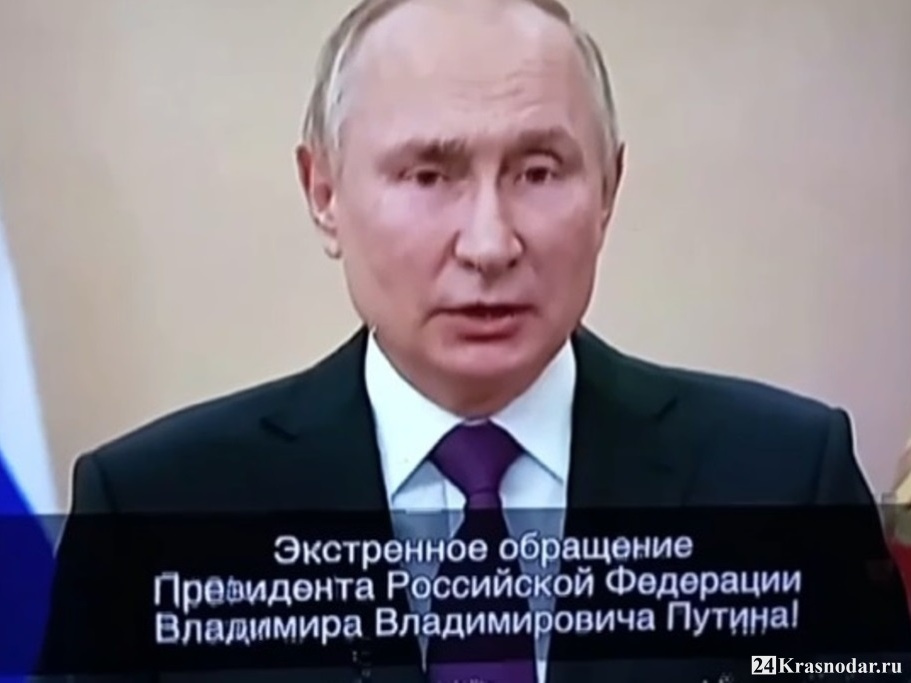

Отечественные СМИ сообщили о том, что жители некоторых регионов страны услышали по радио и телевидению фейковое обращение Владимира Путина о введении военного положения и всеобщей мобилизации.

В частности, телеканал «Мир» заявил о вмешательстве в эфир неустановленных лиц. Как все это осуществляется мошенниками технически, «Собеседник» выяснил у ведущего IT-специалиста компании «Яндекс» Даниила Берштейна.

– Есть такая технология – дипфейк. Программе даются разные позиции лица при разных эмоциях, произношении букв. Технология просто дорисовывает нужное. В этот алгоритм можно загрузить определенные слова и сложить из них любые предложения. Изобрели технологию те, кто делает компьютерные игры, снимает фильмы. А дальше люди стали использовать ее в своих целях. В том числе и таких, мошеннических…

– То есть при желании повторить нечто подобное фейковой речи президента – легко?

– Конечно. В сети столько выступлений любого политика любой страны, любого топ-бизнесмена, что подделать их голос или видео не составляет абсолютно никакой проблемы. Сейчас набирает обороты мошенничество, связанное с дипфейком лицевым и аудио. Особенно легко так обманывают пожилых людей. Звонят человеку и включают запись. Аудиопики речи повторяют с помощью компьютера, и речь становится очень похожей на заданный монолог реального человека. Даже если гражданин совершенно не публичный, пики голоса записать очень просто – достаточно предложить ему какой-нибудь опросник. Пики на гласных, остановку для дыхания… Всё, у мошенников есть индивидуальный набор пиков голоса, который они используют.

– И нет законов, ограничивающих дипфейки?

– В некоторых странах мира уже запретили определенный алгоритм машинного обучения. У нас пока нет.